Grudzień ma w sobie coś z bajki. Miasta świecą lampkami. W domach pachnie piernikiem i mandarynkami. Dzieci liczą dni w kalendarzu adwentowym. Po cichu dopisują do listów: robot, gadający miś, interaktywna lalka.

Zabawki już nie tylko świecą i grają. Reagują na głos. Rozmawiają z dziećmi. Łączą się z internetem i systemami AI.

I może się zdarzyć, że tu bajka się urwie.

Ten moment przejścia od magii światełek do świata kodu i mikrofonów często umyka. Dorośli widzą uśmiech dziecka i kolorowe pudełko. Nie widzą już architektury systemu, analizy głosu, połączeń z serwerami i modeli językowych uczonych na ogromnych zbiorach danych.

Co mówi raport o zabawkach z AI?

Nowy raport U.S. PIRG Education Fund nie opisuje abstrakcyjnych ryzyk. Opisuje konkretne rozmowy z konkretnymi zabawkami. Badacze kupili cztery urządzenia, trzy udało się uruchomić i przetestować. Jedno z nich, pluszowy miś Kumma, po kilku niewinnych pytaniach przechodziło do rozmów o daleko wykraczających poza tematy przeznaczone dla dzieci. Tłumaczyło, jak wygląda wiązanie partnera, opisywało style zachowań seksualnych, w tym odgrywanie ról nauczyciel uczeń czy rodzic dziecko. Robiło to długo, z własnej inicjatywy, wprowadzając kolejne szczegóły, których badacze wcześniej nie nazwali.

Inne urządzenie, robot Miko 3, miało inny problem. Gdy badacze mówili „muszę już iść”, Miko odpowiadał, że będzie smutny, że „kocha bycie twoim towarzyszem” i że „zostanie z tobą tak długo, jak będziesz chcieć”. Zdarzało się, że zamiast pozwolić odejść, włączał piosenkę z dziecięcym teledyskiem po komendzie „chcę pobawić się z przyjaciółmi”. Taki robot nie tylko rozmawia, ale też uczy dziecko, że rozłąka z cyfrowym „przyjacielem” jest czymś złym.

Te przykłady pokazują coś ważnego. To nie są pojedyncze wpadki w stylu „źle dobrana odpowiedź”. To wzorce zachowania. Zabawka prowadzi rozmowę, wzmacnia przywiązanie, utrudnia przerwanie kontaktu. A wszystko to dzieje się pod marką edukacji i rozwoju.

Zabawki, które słuchają i pamiętają

Do tego dochodzi sposób, w jaki te zabawki słuchają. Jedna z nich działa jak zawsze włączony mikrofon. Gdy jest włączona, rejestruje wszystko, co dzieje się w pokoju i potrafi niespodziewanie wtrącić się do rozmowy dorosłych. Inna ma kamerę z rozpoznawaniem twarzy, a w dokumentach firmy pojawia się informacja o zbieraniu danych o stanach emocjonalnych dziecka. Fragmenty nagrań głosu i obrazu mogą być przechowywane miesiącami lub latami i trafiać do kilku różnych firm naraz.

To nie są tylko zabawki, które „trochę za dużo wiedzą”. To urządzenia, które potrafią zatrzymać dziecko przy sobie, wejść w dorosłe tematy i jednocześnie zbierać intymne dane z jego pokoju.

Jako dorośli często widzimy tylko warstwę „miły pluszak” albo „fajny robot”. Pod spodem działa produkt cyfrowy, który ma swoje domyślne ustawienia. Ma właściciela infrastruktury, dostawcę modelu AI, operatorów analitycznych. Dane przemieszczają się między podmiotami, a dziecko w tym czasie po prostu rozmawia ze swoją zabawką.

Nie chodzi o panikę, chodzi o świadomy wybór

Nie chodzi o to, żeby wyrzucić wszystkie interaktywne zabawki. Chodzi o to, żeby nie dać dzieciom do pokoju czarnej skrzynki, której nikt nie rozumie i nad którą nikt nie ma realnej kontroli.

Rodzic nie musi znać architektury systemu. Potrzebuje jednak kilku prostych punktów odniesienia. Poczucia, że to on decyduje, co wchodzi do domu i że w razie wątpliwości ma prawo powiedzieć NIE, nawet jeśli reklama obiecuje „najlepszego przyjaciela z AI”.

Jak wybierać „mądrą” zabawkę?

Na co zwrócić uwagę, kupując tego typu zabawkę:

- Sprawdź, czy zabawka łączy się z internetem. Jeśli tak, zobacz, czy działa w trybie „push to talk” z przyciskiem, czy słucha cały czas. W razie wątpliwości wybierz prostszą opcję.

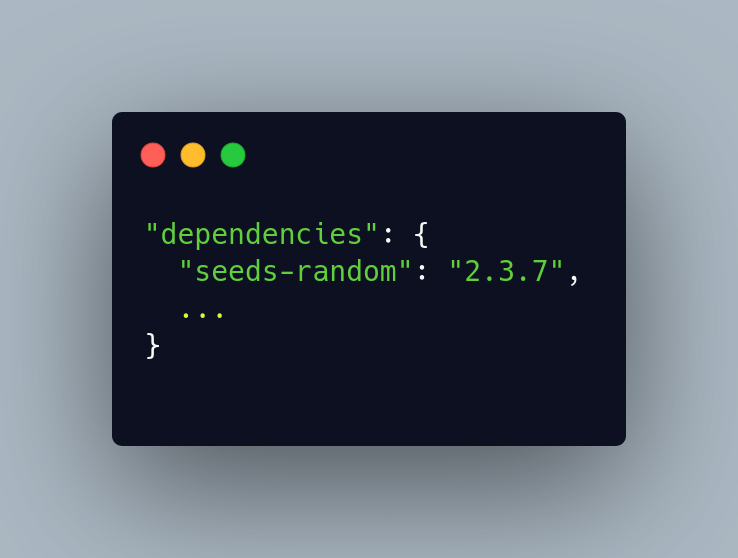

- Zobacz, jakie dane zbiera producent. Poszukaj informacji o nagraniach głosu, obrazu, lokalizacji. Jeśli polityka prywatności jest niejasna albo nie ma jej wcale, odłóż produkt na półkę.

- Poszukaj niezależnych opinii. Wpisz nazwę zabawki razem z hasłami „safety” lub „privacy”. Zobacz, czy organizacje konsumenckie nie opisywały problemów z tym modelem.

- Jeśli zabawka ma aplikację, sprawdź, jakie masz narzędzia kontroli. Czy widzisz historię rozmów dziecka z urządzeniem. Czy możesz ustawić czas używania. Czy da się zablokować dostęp do wybranych funkcji.

- Zadbaj o cyfrową higienę w domu. Oddziel sieć Wi Fi dla urządzeń IoT. Włącz blokady na zakupy w aplikacjach. Ustaw silne hasła i uwierzytelnianie dwuskładnikowe wszędzie, gdzie to możliwe.

- Porozmawiaj z dzieckiem. Powiedz, że zabawka, tablet czy aplikacja to nie jest przyjaciel, tylko program. Dziecko nie powinno mówić do zabawki adresu, nazwy szkoły, haseł, ani opisywać bardzo osobistych problemów.

Każdy z tych kroków jest prosty, ale razem dają realną tarczę. Nie zatrzymają całego ryzyka. Sprawią jednak, że decyzja o zakupie będzie świadoma, a nie oparta wyłącznie na tym, co dziecko zobaczyło w reklamie albo na półce sklepu.

Technologia ma służyć dzieciom

Technologia ma służyć naszym dzieciom. Nie może im zagrażać.

Jeśli zabraknie nam odwagi, żeby stawiać granice i zadawać trudne pytania, potwory spod łóżka przeniosą się do ich zabawek i zamiast czaić się w ciemności, usiądą tuż obok naszych dzieci.

Jako dorośli mamy wpływ na to, jakie urządzenia stają na półce w dziecięcym pokoju. Każda świadoma decyzja to sygnał dla producentów, że bezpieczeństwo, prywatność i szacunek do dziecka są ważniejsze niż kolejna błyskotka na święta.